Norwegen plant Social-Media-Grenze ab 16 Jahren

Norwegen macht ernst. Die Regierung will noch in diesem Jahr einen Gesetzentwurf ins Parlament einbringen, der Kindern und Jugendlichen den Zugang zu sozialen Netzwerken erst ab dem Jahr erlauben soll, in dem sie 16 Jahre alt werden.

Damit würde nicht das genaue Geburtsdatum entscheiden, sondern der Jahrgang. Ganze Schulklassen würden also gleichzeitig Zugang bekommen. Ziel ist es, soziale Unterschiede innerhalb einer Altersgruppe zu vermeiden. Wenn einige Kinder in einer Klasse früher Zugang zu Instagram, TikTok, Snapchat oder anderen Plattformen bekommen als andere, entsteht schnell sozialer Druck. Wer noch nicht dabei ist, fühlt sich ausgeschlossen. Wer dabei ist, zieht andere mit hinein. Genau diesen Gruppendruck will Norwegen reduzieren.

Ein wichtiger Punkt dabei: Norwegen ist kein Mitglied der Europäischen Union. Das Land gehört aber zum Europäischen Wirtschaftsraum. Dadurch ist Norwegen eng an viele europäische Regeln angebunden, vor allem im Binnenmarkt und im digitalen Bereich. Auch wenn Norwegen formal nicht zur EU gehört, orientiert es sich stark an europäischen Vorgaben und übernimmt viele Regelungen. Deshalb ist der norwegische Vorstoß auch für die europäische Debatte wichtig.

Denn die Frage steht längst nicht mehr nur in Norwegen im Raum. Immer mehr Länder diskutieren, ob Kinder und jüngere Jugendliche vor sozialen Netzwerken besser geschützt werden müssen.

Bild generiert mit Hilfe von KI (ChatGPT/DALL·E, OpenAI)

Warum Norwegen diesen Schritt geht

Die norwegische Regierung begründet den geplanten Gesetzentwurf mit dem Schutz von Kindern und Jugendlichen. Es geht dabei nicht nur um einzelne problematische Inhalte. Es geht um die Grundstruktur sozialer Netzwerke.

Soziale Netzwerke sind nicht einfach digitale Treffpunkte. Sie sind Plattformen, die mit Algorithmen arbeiten. Sie messen, worauf Kinder reagieren, was sie lange anschauen, worauf sie klicken, was sie teilen und wo sie hängenbleiben. Aus diesen Daten entstehen immer genauere Profile. Danach werden Inhalte ausgespielt, die möglichst viel Aufmerksamkeit erzeugen.

Für Erwachsene ist es schon schwer genug, sich diesen Mechanismen zu entziehen. Für Kinder und jüngere Jugendliche ist es noch schwieriger. Ihre Fähigkeit zur Selbstkontrolle, zur Einordnung sozialer Vergleiche und zum Umgang mit Druck ist noch nicht ausgereift. Gleichzeitig treffen sie auf Systeme, die genau diese Schwächen ausnutzen können.

Es geht also nicht nur darum, ob ein Kind „ein bisschen TikTok“ schaut oder „ab und zu Snapchat“ nutzt. Es geht um eine digitale Umgebung, die jederzeit präsent ist, in der Rückmeldungen wie Likes und Kommentare sichtbar sind und die Kinder früh daran gewöhnt, sich daran zu orientieren.

Norwegen zieht daraus eine politische Konsequenz: Kinderschutz darf nicht allein von Familien abhängen.

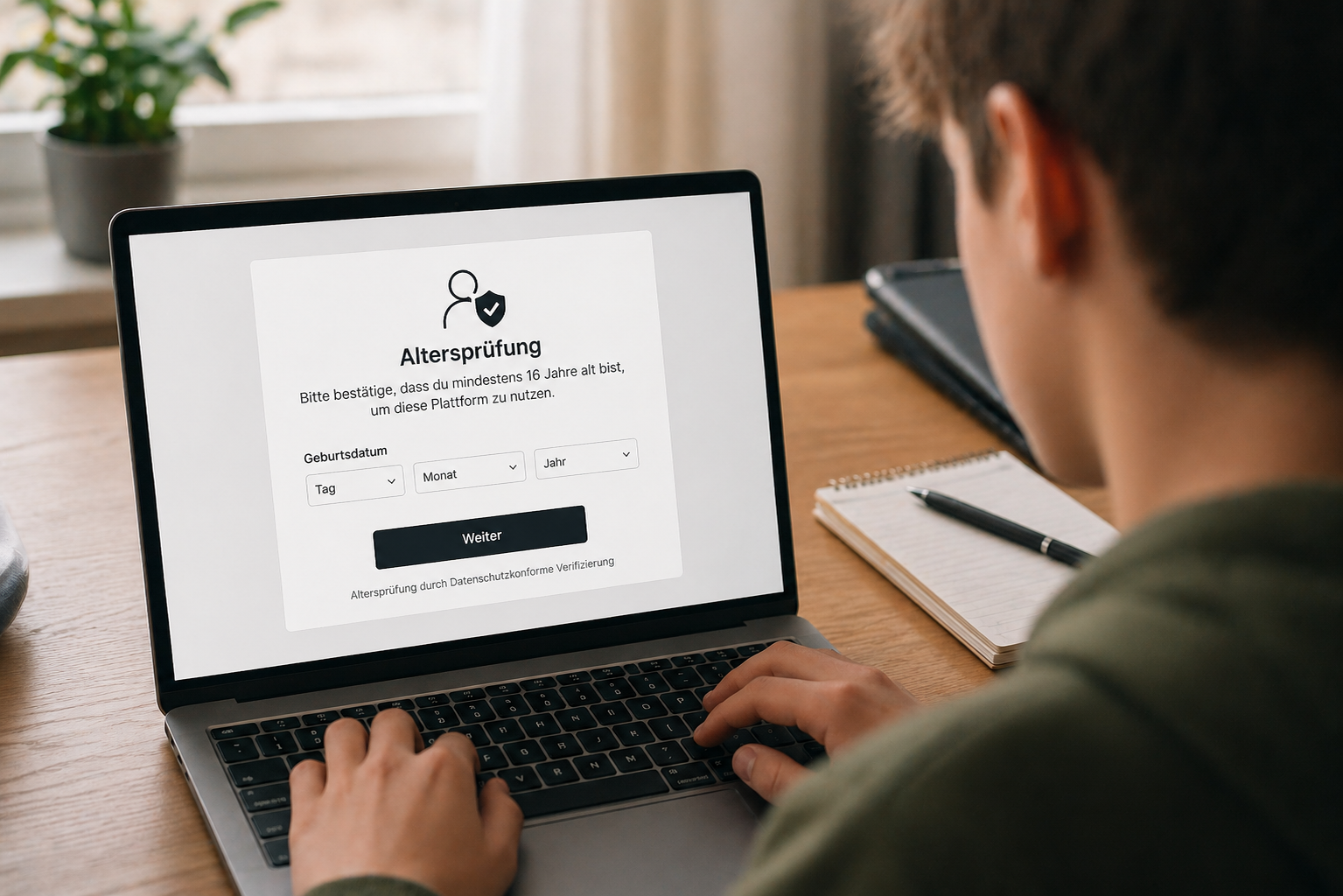

Plattformen sollen das Alter prüfen

Bild generiert mit Hilfe von KI (ChatGPT/DALL·E, OpenAI)

Der entscheidende Unterschied zu vielen bisherigen Ansätzen liegt nicht darin, dass Norwegen als einziges Land über Altersprüfung spricht. Das tun inzwischen viele Länder in Europa. Auch Frankreich, Spanien, Dänemark und Griechenland arbeiten an strengeren Regeln oder fordern gemeinsame europäische Lösungen. Die EU-Kommission hat zudem eine technische Lösung zur Altersprüfung vorgestellt, die künftig helfen soll, Altersgrenzen datenschutzfreundlicher umzusetzen.

Besonders am norwegischen Modell ist aber die konkrete Verbindung mehrerer Punkte: Die Grenze soll ab dem Jahr gelten, in dem Jugendliche 16 Jahre alt werden. Ganze Jahrgänge würden also gleichzeitig Zugang bekommen. Gleichzeitig sollen die Plattformen selbst verpflichtet werden, das Alter beim Login zu prüfen. Die Verantwortung soll damit nicht bei Kindern oder Eltern hängenbleiben, sondern bei den Anbietern der Dienste.

Das ist ein zentraler Punkt. Denn eine Altersgrenze ist nur dann wirksam, wenn sie nicht einfach durch eine falsche Geburtsjahresangabe umgangen werden kann. Genau das ist heute bei vielen Diensten der Fall. Kinder geben ein anderes Geburtsdatum ein und sind innerhalb weniger Sekunden auf Plattformen, die offiziell eigentlich nicht für sie gedacht sind.

Norwegen will deshalb die technische Verantwortung klar bei den Plattformen verankern. Es geht nicht nur um ein neues Mindestalter auf dem Papier, sondern um die Frage, wer es tatsächlich durchsetzen muss.

Genau darin liegt die politische Bedeutung: Der Schutz von Kindern soll nicht länger vor allem eine private Aufgabe der Familien sein, sondern eine Pflicht der Plattformen, die diese digitalen Räume betreiben.

Altersgrenze, Jahrgangslogik und Plattformpflicht beim Login sind angekündigt. Die konkrete technische Umsetzung ist noch offen.

Wie könnte die Altersprüfung funktionieren?

Die praktische Umsetzung ist der schwierigste Teil des Vorhabens.

Eine Altersgrenze klingt zunächst einfach. Entscheidend ist aber, ob sie sich tatsächlich durchsetzen lässt. Genau daran scheitern viele bestehende Regeln. In der Praxis reicht oft ein falsches Geburtsdatum, um Zugang zu bekommen.

Norwegen hat bislang vor allem eines klar formuliert: Die Plattformen sollen verpflichtet werden, das Alter beim Login zu prüfen. Wie genau das technisch umgesetzt wird, ist noch offen und soll im weiteren Gesetzgebungsprozess geklärt werden.

Damit steht das Land vor einer zentralen Herausforderung, die aktuell ganz Europa beschäftigt. Eine Altersprüfung muss zuverlässig funktionieren, darf aber gleichzeitig nicht dazu führen, dass noch mehr sensible Daten bei Plattformen landen.

Es geht also nicht nur um die Frage, ob geprüft wird, sondern auch wie. Genau hier wird sich entscheiden, ob die Regelung am Ende wirksam ist oder nur auf dem Papier existiert.

Warum der Jahrgang entscheidend ist

Besonders interessant ist die Idee, nicht das genaue Geburtsdatum entscheiden zu lassen, sondern den Jahrgang.

Das klingt zunächst ungewöhnlich, hat aber einen sozialen Hintergrund. In Schulklassen entstehen Unterschiede oft nicht durch abstrakte Regeln, sondern durch Gruppendynamik. Wenn einige Jugendliche früher auf eine Plattform dürfen als andere, entsteht Druck. Wer noch nicht dabei ist, kann leichter ausgeschlossen werden. Eltern geraten unter Druck, weil andere Kinder angeblich schon alles dürfen. Kinder wiederum argumentieren mit der Klassengemeinschaft.

Wenn der Zugang jahrgangsweise geregelt wird, könnten ganze Altersgruppen gleichzeitig freigeschaltet werden. Das würde die Regel für Familien einfacher machen. Es gäbe weniger Diskussionen darüber, warum ein Kind schon darf und ein anderes noch nicht. Der soziale Druck innerhalb einer Klasse könnte sinken.

Für Eltern wäre das ein wichtiger Vorteil. Denn viele Familien scheitern nicht daran, dass sie keine Haltung haben. Sie scheitern am Druck der Gruppe. Sobald in einer Klasse die ersten Kinder auf bestimmten Plattformen sind, verschiebt sich die Norm. Aus „noch nicht“ wird schnell „alle anderen dürfen aber“.

Genau hier setzen kollektive Regeln an. Sie entlasten einzelne Familien.

Welche Plattformen wären betroffen?

Bild generiert mit Hilfe von KI (ChatGPT/DALL·E, OpenAI)

Welche Plattformen genau unter die geplante Regelung fallen würden, ist bislang noch nicht abschließend geklärt. Die norwegische Regierung spricht von sozialen Medien und will Plattformen verpflichten, das Alter junger Nutzer beim Login zu prüfen.

Naheliegend ist, dass klassische soziale Netzwerke und Plattformen mit Profilen, Feeds, Empfehlungen, Kommentaren und öffentlicher Interaktion im Mittelpunkt stehen. Dazu könnten Dienste wie TikTok, Instagram, Snapchat, Facebook, YouTube oder ähnliche Angebote gehören. Eine offizielle, abschließende Liste gibt es bisher aber nicht.

Offen ist auch, wie mit Messenger-Diensten umgegangen wird. Viele Messenger sind heute nicht mehr nur private Kommunikationsmittel. Sie enthalten Kanäle, Statusfunktionen, Gruppen, öffentliche Inhalte oder Empfehlungslogiken. Gleichzeitig erfüllen sie für Kinder und Familien oft eine andere Funktion als klassische Social-Media-Plattformen.

Genau deshalb wird die Definition im Gesetz entscheidend sein. Geht es nur um klassische soziale Netzwerke? Geht es um Plattformen mit algorithmischen Feeds und öffentlicher Sichtbarkeit? Oder werden auch Dienste erfasst, die Kommunikation, Gruppen und soziale Funktionen verbinden?

Diese Abgrenzung ist wichtig, weil Kinder digitale Räume nicht nach juristischen Kategorien nutzen. Für sie zählt, wo Freunde sind, wo Inhalte geteilt werden und wo sozialer Druck entsteht. Eine wirksame Regelung muss deshalb klar genug sein, um Plattformen in die Pflicht zu nehmen, aber präzise genug, um private Kommunikation, Datenschutz und berechtigte Alltagsnutzung nicht unnötig zu gefährden.

Was passiert beim Login?

Der Unterschied liegt im Zeitpunkt der Prüfung.

Heute findet die Altersabfrage meist nur bei der Registrierung statt. Nutzer geben einmal ihr Geburtsdatum an und haben danach dauerhaft Zugang. Genau deshalb ist das System so leicht zu umgehen.

Der norwegische Ansatz geht darüber hinaus. Die Prüfung soll nicht nur beim Erstellen eines Accounts stattfinden, sondern beim Zugang selbst. Also dann, wenn jemand die Plattform nutzt.

Das ist entscheidend, weil viele Kinder bereits Accounts haben oder fremde Zugänge nutzen. Eine Prüfung beim Login würde auch bestehende Profile erfassen.

In der Praxis bedeutet das: Eine Plattform müsste vor dem Zugriff sicherstellen, dass die Person alt genug ist. Erst dann wird der Zugang freigegeben.

Wie genau diese Prüfung technisch umgesetzt wird, ist noch offen. Klar ist aber: Ohne eine Kontrolle beim Zugang bleibt jede Altersgrenze leicht umgehbar.

Welche Rolle spielt der Digital Services Act?

Auch wenn Norwegen kein EU-Mitglied ist, ist der Digital Services Act für die Debatte wichtig. Der DSA verpflichtet große Plattformen dazu, Risiken für Minderjährige zu bewerten und zu reduzieren. Dazu gehören unter anderem Risiken durch algorithmische Empfehlungssysteme, manipulative Gestaltung, Werbung und Inhalte, die Kindern schaden können.

Norwegen kann sich an diesen europäischen Vorgaben orientieren und nationale Regeln damit verbinden. Genau das macht den Vorstoß politisch so relevant. Es geht nicht um einen isolierten Sonderweg, sondern um eine Entwicklung, die in mehreren europäischen Ländern sichtbar wird.

Der DSA allein setzt allerdings keine allgemeine Altersgrenze ab 16 Jahren. Er schafft eher einen Rahmen, in dem Plattformen stärker für Risiken verantwortlich gemacht werden. Norwegen geht nun einen Schritt weiter und will eine konkrete Altersgrenze gesetzlich festlegen.

Das ist ein wichtiger Unterschied.

Europäische Regulierung sagt zunehmend: Plattformen müssen Kinder besser schützen.

Norwegen sagt zusätzlich: Bestimmte Plattformen sollen für Kinder unter 16 gar nicht erst zugänglich sein.

Warum Deutschland nicht einfach dasselbe machen kann

In Deutschland wird ebenfalls über Altersgrenzen für soziale Netzwerke diskutiert. Trotzdem passiert bisher deutlich weniger als viele erwarten. Der Hauptgrund liegt weniger in einzelnen nationalen Gesetzen, sondern im europäischen Rahmen.

Mit dem Digital Services Act hat die EU bereits Regeln für große Plattformen geschaffen. Plattformen müssen Risiken für Kinder reduzieren, gefährliche Inhalte besser kontrollieren und mehr Verantwortung übernehmen. Was der DSA aber nicht festlegt: eine klare Altersgrenze für soziale Netzwerke.

Genau hier liegt das Problem.

Solange es keine einheitliche europäische Altersregel gibt, bleibt vieles unverbindlich. Plattformen müssen zwar Schutzmaßnahmen anbieten, aber sie entscheiden selbst, wie diese aussehen. In der Praxis bedeutet das oft: Einstellungen, Hinweise, freiwillige Tools. Kein echter Schutz, der für alle gilt.

Deutschland kann deshalb nicht einfach isoliert eine harte Altersgrenze durchsetzen, ohne in Konflikt mit europäischen Regeln zu geraten oder an deren Grenzen zu stoßen. Gleichzeitig fehlt auf europäischer Ebene bisher der politische Konsens für eine klare Lösung.

Das führt zu einer typischen Situation:

Alle sehen das Problem.

Viele sprechen darüber.

Aber verbindliche Regeln fehlen.

Für Familien hat das konkrete Folgen. Eltern sollen Regeln durchsetzen, während Plattformen weiter funktionieren wie bisher. Kinder bewegen sich in Systemen, die auf maximale Nutzung ausgelegt sind. Und echte Schutzmechanismen bleiben lückenhaft.

Genau deshalb ist der Blick nach Norwegen interessant. Norwegen versucht, eine klare Linie zu ziehen: eine Altersgrenze und eine Verpflichtung für Plattformen, diese auch technisch durchzusetzen. Ob das funktioniert, wird sich zeigen. Aber es setzt einen wichtigen Impuls.

Denn je mehr Länder konkrete Regeln einführen, desto größer wird der Druck, auch auf europäischer Ebene nachzuziehen.

Und genau das wäre am Ende entscheidend: eine klare, verbindliche Lösung, die nicht nur diskutiert wird, sondern tatsächlich wirkt.

Warum Eltern allein überfordert sind

Bild generiert mit Hilfe von KI (ChatGPT/DALL·E, OpenAI)

Viele Eltern kennen das Problem aus dem Alltag.

Ein Kind möchte Snapchat, weil die Klasse dort kommuniziert. Ein anderes möchte TikTok, weil dort alle Trends stattfinden. Wieder ein anderes möchte Instagram, weil ältere Geschwister oder Freunde dort aktiv sind. Eltern sagen zunächst Nein. Dann kommt der soziale Druck. Andere dürfen es angeblich längst. Man wolle nicht ausgeschlossen sein. Man brauche die App doch nur zum Schreiben. Man werde sonst nichts mitbekommen.

Diese Dynamik ist mächtig. Sie betrifft nicht nur einzelne Familien, sondern ganze Klassen und Freundeskreise.

Deshalb ist es zu einfach, immer nur auf elterliche Verantwortung zu verweisen. Natürlich tragen Eltern Verantwortung. Natürlich müssen sie begleiten, erklären und Grenzen setzen. Aber sie handeln nicht in einem neutralen Umfeld. Sie handeln in einem Markt, in dem Plattformen wirtschaftlich davon profitieren, dass möglichst viele Menschen möglichst früh, möglichst lange und möglichst intensiv ihre Dienste nutzen.

Wenn ein einzelnes Elternhaus Nein sagt, während das soziale Umfeld Ja sagt, entsteht Druck. Wenn eine ganze Schule, eine ganze Altersgruppe oder ein Staat klare Regeln setzt, verändert sich die Norm.

Genau darin liegt die Stärke solcher Regelungen.

Altersgrenzen sind kein Ersatz für Aufklärung

Eine Altersgrenze allein reicht nicht aus. Das muss klar gesagt werden.

Auch mit 16 verschwinden die Risiken sozialer Netzwerke nicht. Jugendliche können weiterhin unter Vergleichsdruck geraten, problematische Inhalte sehen, in toxische Kommunikationsräume geraten oder zu viel Zeit auf Plattformen verbringen. Auch ältere Jugendliche brauchen Orientierung, Medienbildung und Erwachsene, die mit ihnen im Gespräch bleiben.

Deshalb wäre es falsch, Altersgrenzen als alleinige Lösung zu verkaufen.

Aber es wäre genauso falsch, sie deshalb abzulehnen.

Wir akzeptieren in vielen Bereichen Altersgrenzen, obwohl sie nicht perfekt sind. Niemand würde sagen, Jugendschutz bei Alkohol sei sinnlos, weil Jugendliche manchmal trotzdem trinken. Niemand würde sagen, Altersfreigaben bei Filmen seien überflüssig, weil sie umgangen werden können. Schutzregeln sind nie perfekt. Aber sie setzen gesellschaftliche Standards.

Bei sozialen Netzwerken wurde lange so getan, als seien Kinder kleine Erwachsene, die mit ausreichend Medienkompetenz schon irgendwie klarkommen. Das war bequem für Plattformen und überfordernd für Familien.

Norwegen stellt diese Haltung infrage.

Was Kritiker einwenden

Natürlich gibt es berechtigte Fragen und Einwände. Und sie sind wichtig. Denn eine Altersgrenze greift tief in die digitale Realität von Kindern, Jugendlichen und Familien ein.

Die zentrale Frage lautet: Wie lässt sich so eine Regel überhaupt sinnvoll umsetzen? Es geht dabei nicht nur um Technik, sondern auch um Grundrechte, Alltagstauglichkeit und Nebenwirkungen.

Bild generiert mit Hilfe von KI (ChatGPT/DALL·E, OpenAI)

Zunächst steht die praktische Umsetzung im Raum.

Wie wird das Alter geprüft? Wer kontrolliert die Plattformen? Was passiert bei Fehlern? Und wie wird verhindert, dass Kinder einfach falsche Angaben machen oder Wege finden, die Regeln zu umgehen?

Viele bestehende Systeme zeigen, dass sich Altersabfragen leicht austricksen lassen. Eine wirksame Lösung müsste deutlich robuster sein. Gleichzeitig darf sie nicht dazu führen, dass neue Probleme entstehen.

Ein zentraler Kritikpunkt ist deshalb der Datenschutz.

Eine Altersgrenze darf nicht dazu führen, dass Kinder und Jugendliche noch stärker erfasst, identifiziert und überwacht werden. Wenn Plattformen plötzlich Ausweisdaten speichern müssten, wäre das hochproblematisch. Wenn staatliche Stellen umfassende digitale Identitäten kontrollieren, entsteht schnell die Sorge vor Überwachung.

Dabei wird oft übersehen: Eine Altersprüfung würde nicht nur Kinder betreffen, sondern alle Nutzer. Auch Erwachsene müssten nachweisen, dass sie alt genug sind. Damit wird die Datenschutzfrage zu einem Thema für die gesamte Gesellschaft, nicht nur für Familien.

Es geht also um ein sensibles Gleichgewicht: Schutz vor schädlichen Inhalten auf der einen Seite und Schutz der Privatsphäre auf der anderen.

Ein möglicher Ansatz, der in diesem Zusammenhang diskutiert wird, sind gerätebasierte Lösungen. Dabei würden Altersinformationen direkt auf dem Gerät gespeichert, sodass Plattformen nur noch eine Bestätigung erhalten, ob jemand alt genug ist oder nicht. Ziel wäre es, möglichst wenige persönliche Daten weiterzugeben.

Ein weiterer Einwand betrifft die Umgehbarkeit. Kritiker sagen, dass Jugendliche immer Wege finden werden. Sie nutzen Accounts von Freunden, greifen auf ausländische Dienste zu oder wechseln einfach die Plattform. Eine nationale Altersgrenze könne deshalb leicht unterlaufen werden.

Damit verbunden ist die Sorge, dass sich Probleme nur verlagern. Wenn große Plattformen stärker reguliert werden, könnten riskante Inhalte auf kleinere, weniger kontrollierte Dienste ausweichen. Diese sind oft schwerer zu regulieren und bieten noch weniger Schutzmechanismen.

Ein weiterer Punkt ist die Frage nach Altersstufen.

Warum 16 und nicht 14 oder 15? Ist ein 15-Jähriger wirklich so viel weniger kompetent als ein 16-Jähriger? Und was passiert mit Jugendlichen, die knapp unter der Grenze liegen, aber im Alltag längst mit digitalen Medien umgehen?

Hier geht es um Fairness und Verhältnismäßigkeit. Altersgrenzen sind immer pauschal. Sie können individuelle Unterschiede nicht abbilden.

Auch soziale Aspekte spielen eine Rolle. Wenn eine Altersgrenze nicht flächendeckend umgesetzt wird, entsteht Ungleichheit. Einige Kinder halten sich an Regeln, andere nicht. Einige Eltern setzen Grenzen durch, andere nicht. Dadurch kann sich der soziale Druck sogar verstärken, statt zu sinken.

Ein weiterer Einwand betrifft die Rolle der Eltern. Manche argumentieren, dass solche Regeln Eltern entmündigen könnten. Entscheidungen über Mediennutzung sollten in der Familie getroffen werden, nicht vom Staat. Andere befürchten, dass Eltern sich zu sehr auf gesetzliche Regeln verlassen und weniger selbst begleiten.

Hinzu kommt die wirtschaftliche Perspektive. Plattformen verdienen Geld mit Aufmerksamkeit. Je früher Kinder einsteigen, desto länger bleiben sie oft. Strengere Altersgrenzen greifen deshalb direkt in Geschäftsmodelle ein. Kritiker warnen, dass Unternehmen versuchen könnten, Regeln zu umgehen, abzuschwächen oder technisch auszutricksen.

Auch die technische Umsetzung selbst ist ein kritischer Punkt.

Eine gute Altersprüfung müsste mehrere Anforderungen gleichzeitig erfüllen. Sie müsste zuverlässig sein, datensparsam funktionieren, einfach nutzbar sein und gleichzeitig für Millionen von Nutzern skalieren.

Das ist anspruchsvoll, aber nicht unmöglich.

Und genau hier liegt der Kern der Debatte. Die Frage ist nicht, ob es perfekte Lösungen gibt. Die Frage ist, ob wir bereit sind, bessere Lösungen umzusetzen als das, was heute existiert.

Denn der Status quo hat ebenfalls Konsequenzen. Kinder bewegen sich in digitalen Systemen, die auf maximale Nutzung ausgelegt sind. Altersgrenzen existieren oft nur auf dem Papier. Schutzmaßnahmen sind lückenhaft. Verantwortung wird auf Familien abgewälzt.

Auch das ist eine Entscheidung, nur wird sie selten so benannt.

Deshalb ist es richtig, die Einwände ernst zu nehmen. Aber genauso wichtig ist es, sie nicht als Argument für Stillstand zu nutzen. Am Ende wird es darum gehen, Lösungen zu entwickeln, die Schutz und Freiheit zusammenbringen.

Warum technische Umsetzung politisch entscheidend ist

Die Debatte über Altersgrenzen scheitert oft an einem Missverständnis. Manche tun so, als gehe es nur um ein Verbot auf dem Papier. Andere tun so, als sei technische Umsetzung grundsätzlich unmöglich. Beides greift zu kurz.

Eine Altersgrenze braucht eine funktionierende technische Infrastruktur. Ohne sie bleibt sie Symbolpolitik. Gleichzeitig darf man technische Schwierigkeiten nicht als Ausrede verwenden, um gar keine Regeln zu schaffen. Plattformen lösen jeden Tag hochkomplexe technische Probleme, wenn es um Werbung, Tracking, Personalisierung, Zahlungsprozesse oder Wachstum geht. Beim Schutz von Kindern wird dagegen erstaunlich oft behauptet, vieles sei kaum machbar.

Genau hier wird die politische Frage sichtbar: Wofür wird technische Innovation eingesetzt?

Für noch präzisere Werbung gibt es enorme Investitionen. Für noch längere Nutzungsdauer gibt es ausgefeilte Mechanismen. Für bessere Altersprüfung, weniger Suchtmechanismen und wirksameren Kinderschutz soll es plötzlich zu kompliziert sein.

Norwegen sendet ein anderes Signal. Wenn Plattformen mit Kindern Geld verdienen oder ihre Aufmerksamkeit binden, müssen sie auch Verantwortung übernehmen.

Was das für Schulen bedeutet

Auch Schulen sind von dieser Debatte betroffen. Denn soziale Netzwerke bleiben nicht zu Hause. Sie wirken in den Schulalltag hinein.

Konflikte aus Klassenchats landen morgens im Unterricht. Beleidigungen, Ausgrenzung, Bilder, Gerüchte und Mutproben verbreiten sich über digitale Kanäle. Kinder kommen übermüdet in die Schule, weil sie abends nicht vom Gerät loskommen. Aufmerksamkeit, Konzentration und Frustrationstoleranz leiden. Lehrkräfte müssen Probleme auffangen, die außerhalb der Schule entstehen, aber mitten in der Schule wirksam werden.

Eine Altersgrenze ab 16 würde Schulen nicht alle Probleme abnehmen. Aber sie könnte einen klareren Rahmen schaffen. Wenn soziale Netzwerke für jüngere Schülerinnen und Schüler nicht selbstverständlich dazugehören, verändert das auch die schulische Dynamik.

Das gilt besonders dann, wenn solche Regeln mit smartphonefreien Schulkonzepten, Elternabenden, Medienbildung und klaren Klassenvereinbarungen verbunden werden.

Was Eltern aus Norwegen lernen können

Für Eltern ist der norwegische Vorstoß vor allem deshalb wichtig, weil er ihre Erfahrung bestätigt.

Viele Eltern spüren längst, dass es nicht reicht, nur individuell zu entscheiden. Sie merken, dass sie gegen Gruppendruck, Plattformdesign und permanente Verfügbarkeit ankämpfen. Sie erleben, dass technische Kinderschutzfunktionen oft lückenhaft sind oder leicht umgangen werden können. Sie sehen, dass Kinder in digitale Räume geraten, für die sie emotional noch nicht bereit sind.

Norwegen sagt im Grunde: Dieses Problem ist nicht nur privat. Es ist gesellschaftlich.

Das ist eine wichtige Verschiebung.

Eltern müssen nicht perfekt sein, um Schutz einzufordern. Sie müssen nicht jede App im Detail verstehen, um zu erkennen, dass viele Plattformen für Kinder nicht geeignet sind. Und sie müssen sich nicht einreden lassen, dass alles nur eine Frage guter Erziehung sei.

Gute Erziehung bleibt wichtig. Aber sie braucht einen Rahmen, der Kinder schützt und Eltern entlastet.

Verbote und Aufklärung gehören zusammen

Die Debatte wird oft falsch geführt. Auf der einen Seite stehen angeblich die Verbotsbefürworter. Auf der anderen Seite die Verfechter von Medienkompetenz. Diese Gegenüberstellung hilft nicht weiter.

Wir brauchen beides.

Kinder brauchen Aufklärung, Gespräche, Vertrauen und Medienbildung. Sie müssen lernen, digitale Inhalte einzuordnen, Manipulation zu erkennen und sich selbst zu schützen. Aber sie brauchen auch Grenzen. Vor allem dort, wo die Systeme stärker sind als ihre Entwicklungsfähigkeit.

Ein Kind lernt nicht schwimmen, indem man es allein ins offene Meer wirft. Man begleitet es, erklärt, übt und schützt es vor Situationen, die es noch nicht bewältigen kann.

Genau so sollten wir über soziale Netzwerke sprechen.

Nicht jedes digitale Risiko lässt sich durch ein Gespräch am Küchentisch lösen. Nicht jede Plattform wird durch Medienkompetenz kindgerecht. Und nicht jede Verantwortung gehört ins Elternhaus.

Ein Signal an Plattformen

Der norwegische Vorschlag ist auch ein Signal an die Tech-Konzerne.

Jahrelang konnten Plattformen behaupten, sie böten nur neutrale Dienste an. Die Verantwortung liege bei den Nutzern, bei Eltern, bei Schulen oder bei Einstellungen in der App. Gleichzeitig wurden Produkte so gestaltet, dass sie möglichst lange genutzt werden.

Diese Zeit geht langsam zu Ende.

Wenn Staaten Altersgrenzen, Risikoprüfungen und technische Schutzpflichten einführen, wird deutlich: Plattformdesign ist keine Privatsache der Unternehmen. Es hat Auswirkungen auf Kinder, Familien, Schulen und Gesellschaft.

Deshalb müssen Plattformen stärker reguliert werden. Nicht irgendwann. Sondern jetzt.

Fazit: Norwegen zeigt, wohin die Debatte geht

Norwegen ist kein EU-Mitglied. Aber der Vorstoß ist für Europa hoch relevant. Das Land ist über den Europäischen Wirtschaftsraum eng mit europäischen Regeln verbunden und greift eine Debatte auf, die längst in vielen Ländern geführt wird.

Die geplante Altersgrenze ab 16 Jahren ist kein perfektes Instrument. Sie wirft technische, rechtliche und datenschutzrechtliche Fragen auf. Aber sie setzt ein wichtiges Zeichen: Kinder müssen nicht allein in digitale Räume geschickt werden, die selbst Erwachsene kaum kontrollieren können.

Der entscheidende Punkt ist die Verschiebung der Verantwortung.

Nicht Kinder sollen beweisen, dass sie stark genug sind.

Nicht Eltern sollen allein gegen globale Plattformen kämpfen.

Sondern Anbieter müssen ihre Systeme so gestalten, dass Kinder wirksam geschützt werden.

Das ist überfällig.

Eine Gesellschaft, die Kinder schützt, darf soziale Netzwerke nicht behandeln wie harmlose Spielplätze. Sie muss anerkennen, dass diese Plattformen mächtige, kommerzielle, algorithmische Systeme sind. Norwegen geht diesen Schritt nun an. Deutschland sollte sehr genau hinschauen.

Weitere Länder planen Regullierungen

Hier unsere Übersicht: https://www.medienzeit-elternblog.de/blog/uebersicht-social-media-altersgrenzen-europa

Quellen

Offizielle Meldung der Regierung aus Norwegen: https://www.regjeringen.no/en/whats-new/norwegian-social-media-age-restrictions-law-on-track-to-be-introduced-this-year-this-is-how-the-age-limit-for-social-media-will-work/id3157276/

Deutschlandfunk: https://www.deutschlandfunk.de/norwegen-plant-social-media-verbot-fuer-unter-16-jaehrige-102.html

Tagesschau: https://www.tagesschau.de/ausland/europa/norwegen-social-media-verbot-100.html