Du bist 13 und meldest dich bei TikTok an. Was Kinder sehen!

Unsere klare Haltung: Kinder sollten TikTok nicht nutzen. Auf keinen Fall vor 16 und auch nicht mit aktivierten Jugendschutz Einstellungen. Die Plattform zeigt Kindern und Jugendlichen Inhalte, die sie emotional überfordern und gefährden. TikTok ist nicht für die Entwicklung von Kindern gemacht und bietet keinen zuverlässigen Schutz.

Wenn ein Kind sich mit 13 bei TikTok anmeldet, wirkt der Start harmlos. Ein Profilbild, ein Geburtsdatum, ein Klick und die App öffnet sich. Doch ab diesem Moment sieht ein Kind nicht einfach harmlose Clips. Es landet in einem System, das für maximalen Konsum entwickelt wurde und nicht für kindliche Sicherheit. TikTok ist eine Plattform, die jede Bewegung auswertet und Inhalte ausspielt, die möglichst starke Emotionen auslösen. Genau deshalb geraten Kinder innerhalb weniger Minuten in Bereiche, auf die sie nicht vorbereitet sind.

Bild generiert mit Hilfe von KI (Gemini, Google)

Was Kinder direkt nach der Anmeldung sehen

Beispiel einer TikTok Suche

Ein Beispiel aus einem echten Test zeigt das sehr deutlich. Ein neues Konto wird als 13jähriges Kind angelegt. Jugendschutz an, Familienoptionen an, keine einzige Suche eingegeben. Beim ersten Klick auf die Suchseite erscheinen sofort Vorschläge, die nicht für Kinder geeignet sind. Dazu gehören sexuelle Begriffe, intime Themen und Formulierungen, die Kinder selbst sexualisieren. Diese Begriffe tauchen nicht auf, weil das Kind etwas gesucht hat, sondern weil sie auf TikTok stark genutzt werden. Die Plattform setzt Kinder also automatisch problematischen Inhalten aus.

Warum die Schutzfunktionen nicht wirken

TikTok bietet Jugendschutz Werkzeuge an, die Sicherheit vermitteln sollen. Doch Untersuchungen zeigen, dass sie im Alltag kaum greifen. Die Altersprüfung ist lückenhaft. Viele Konten von Minderjährigen sind weiterhin öffentlich sichtbar. Inhalte, die eigentlich gesperrt sein sollten, tauchen trotzdem auf. Kinder können trotz aktivierter Einstellungen Videos sehen, die Gewalt, Sexualität, Extremismus oder seelische Belastung enthalten. Eltern dürfen sich nicht auf die Plattform verlassen. Der Schutz ist nicht zuverlässig.

Wie der Algorithmus Kinder in extreme Inhalte zieht

Der TikTok Algorithmus verstärkt alles, was Aufmerksamkeit erzeugt. Ein Kind sieht ein Beauty Video. Daraus werden Diätvideos. Danach Videos über Essstörungen. Ein Kind sieht ein gesellschaftliches Video. Danach werden populistische Clips angezeigt. Danach Inhalte, die Hass als Meinung tarnen. Ein Kind sieht ein Video über ein verlassenes Tier. Danach tauchen Videos mit Tierleid und Grausamkeit auf. TikTok sucht ständig den nächsten sogenannten Banger. Das sind Inhalte, die schockieren, aufwühlen oder traurig machen. Der Algorithmus belohnt emotionale Intensität. Kinder sehen deshalb immer extremere Inhalte. Und sie können das nicht stoppen.

Warum Kinder diesem System schutzlos ausgeliefert sind

Kinder besitzen keinen inneren Schutzmechanismus gegen solche Systeme. Erwachsene können negative Inhalte einordnen oder bewusst stoppen. Kinder können das nicht. Ihr Gehirn reagiert viel stärker auf schnelle Reize und starke Gefühle. Dadurch geraten sie schnell in zwei Muster, die inzwischen gut erforscht sind.

Bild generiert mit Hilfe von KI (Gemini, Google und ChatGPT, OpenAi)

Doomscrolling

Doomscrolling beschreibt das endlose Weiterwischen durch negative Inhalte. Kinder tun das, weil sie hoffen, dass nach etwas Belastendem etwas Positives kommt. Doch TikTok zeigt stattdessen immer neue negative Reize. Das Kind kommt aus dieser Spirale nicht selbst heraus.

Rabbit Hole

Ein Rabbit Hole ist ein Themenloch. Kinder beginnen mit einem harmlosen Video. Der Algorithmus interpretiert es als Interesse und liefert danach extremere Varianten desselben Themas. Aus Schönheit wird Essstörung. Aus Humor wird Hass. Aus Tierliebe wird Grausamkeit. Aus Neugier wird Angst. Kinder merken nicht, dass sie gelenkt werden. Es fühlt sich an wie die normale Welt, ist aber eine algorithmisch erzeugte Verzerrung.

Gefährliche Challenges und Mutproben

TikTok ist voll von Trends. Einige sind harmlos, viele jedoch nicht. Die Blue Whale Challenge soll Kinder zu gefährlichen Aufgaben drängen. Die Blackout Challenge bringt Kinder dazu, sich die Luft abzuschnüren. Andere Trends fordern Sprünge aus Fenstern, riskante Stunts, Feuer Experimente oder gefährliche Mutproben. Solche Inhalte verbreiten sich schnell, weil sie starke Emotionen erzeugen. Der Algorithmus belohnt genau das. Für Kinder sieht es aus wie ein Spiel. In Wahrheit ist es lebensgefährlich.

Politische Verzerrung, Rassismus und Populismus

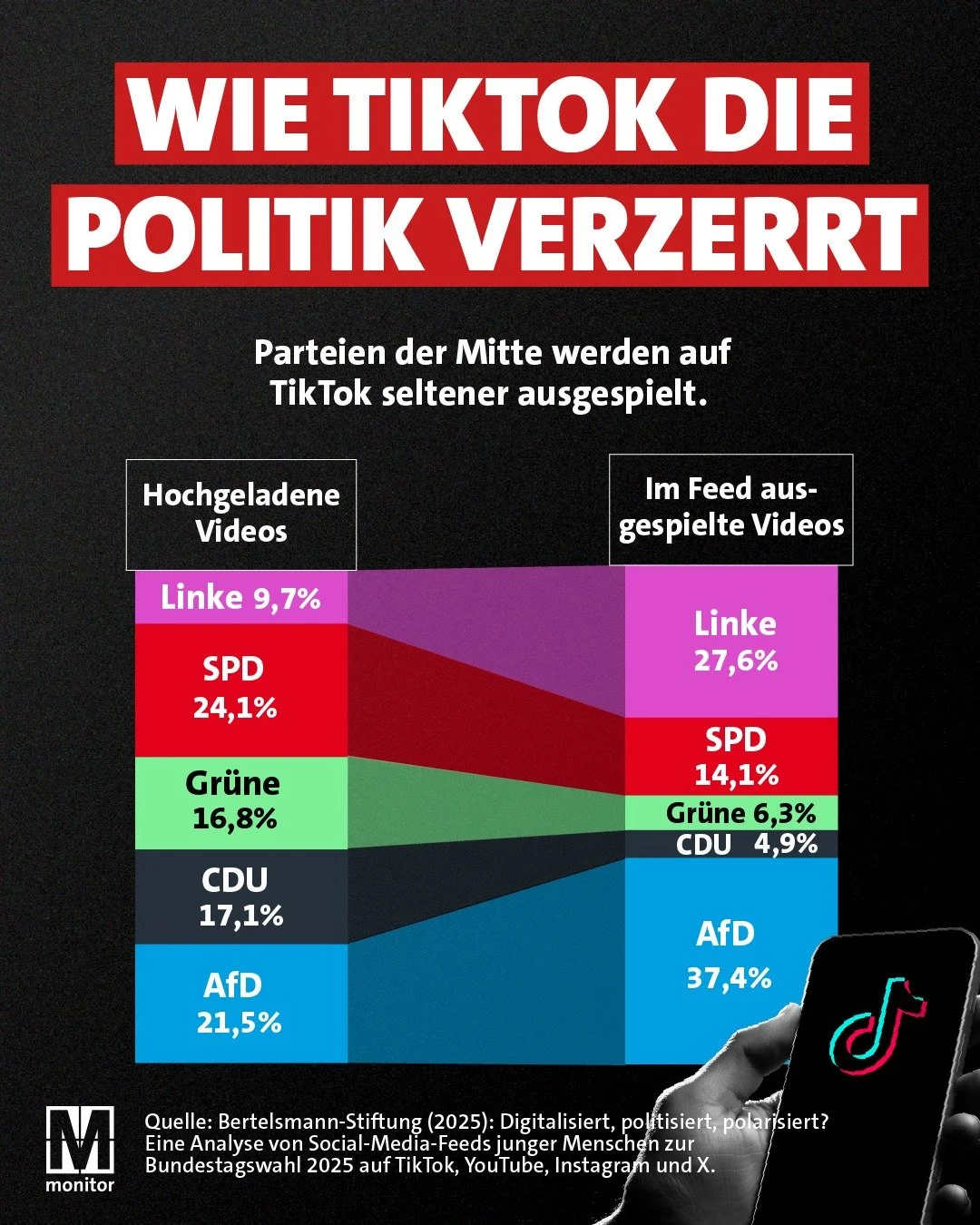

Quelle: @monitor.wdr auf Intagram

TikTok beeinflusst auch politische Wahrnehmung. Eine Analyse der Bertelsmann Stiftung zeigt, dass moderate Parteien deutlich seltener angezeigt werden, während extreme und polarisierende Inhalte stark verstärkt werden. Kinder sehen nicht das politische Spektrum, das existiert, sondern eine verzerrte Version davon. Rassistische Botschaften, einfache Schuldzuweisungen und populistische Narrative tauchen häufiger auf als sachliche Inhalte. TikTok belohnt Empörung, Wut und Spaltung. Kinder können nicht erkennen, dass sie manipuliert werden.

Rechtliche Lage

TikTok erlaubt die Anmeldung ab 13 Jahren. Doch nach deutschem Datenschutzrecht dürfen Kinder erst ab 16 selbst der Verarbeitung ihrer Daten zustimmen. Das bedeutet. Ein 13jähriges Kind bräuchte eigentlich die Zustimmung der Eltern. In der Praxis wird das kaum geprüft. So entsteht eine gefährliche Lücke zwischen der Nutzung und dem Schutz.

Was Eltern tun können

Eltern können nicht verhindern, wie TikTok funktioniert. Aber sie können entscheiden, ob ihr Kind diese App nutzen soll. Sie können erklären, wie solche Plattformen arbeiten, offen über Inhalte sprechen und ihren Kindern ein Gefühl von Sicherheit geben. Doch bei TikTok ist der wichtigste Rat einfach.

Fazit und klare Empfehlung

TikTok ist einfach nicht für Kinder gemacht. Die Plattform zeigt Inhalte, die zu extrem, zu belastend und zu manipulierend sind. Der Jugendschutz funktioniert nicht zuverlässig. Der Algorithmus verstärkt alles, was schockiert. Die Risiken sind real und vielfältig.

Deshalb die klare Empfehlung: Kinder nicht auf TikTok lassen!