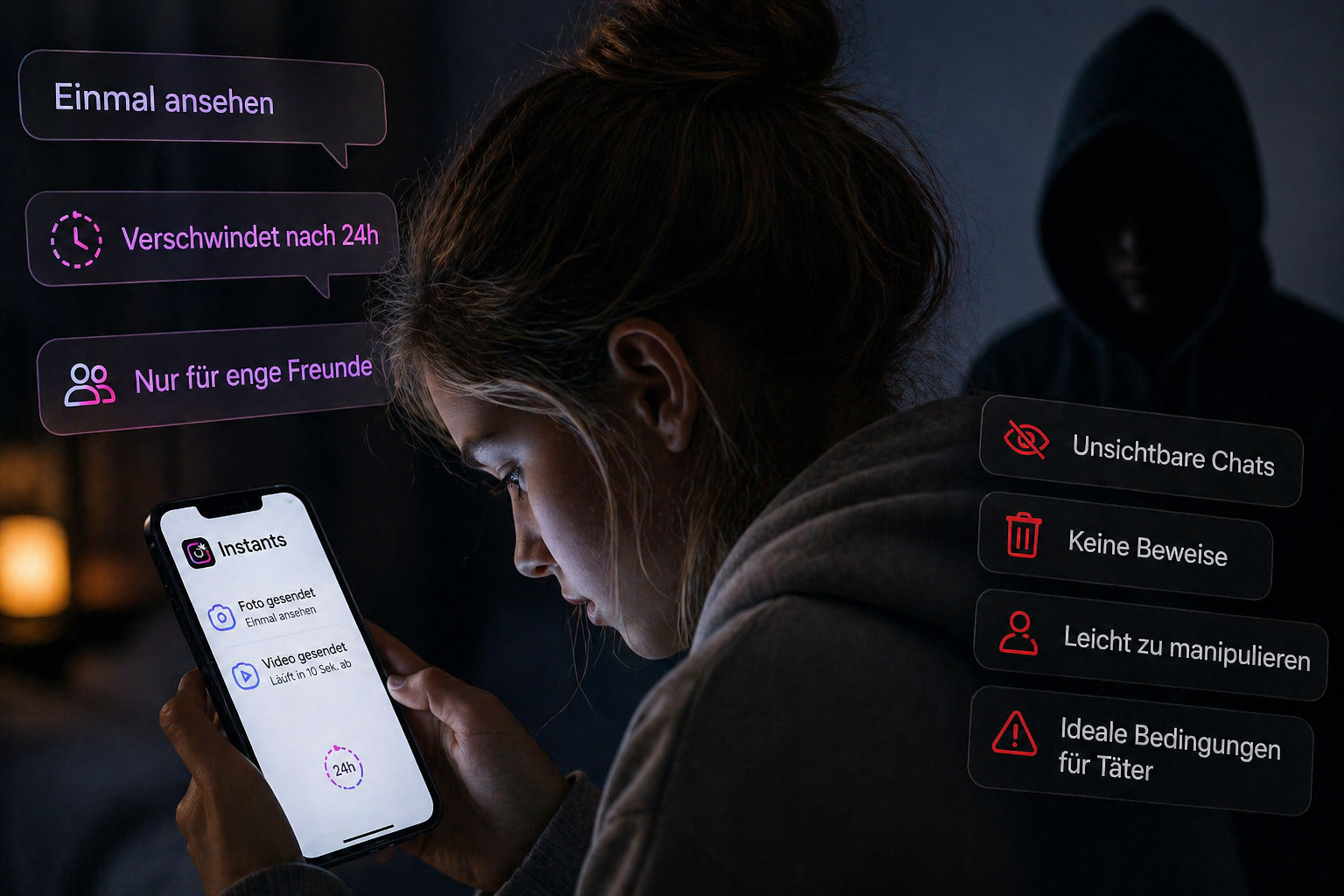

Neue App “Instants”: Instagram kopiert Snapchat – und schafft damit neue Risiken für Kinder

Instagram testet aktuell eine neue App mit dem Namen „Instants“.

Die Idee dahinter ist nicht neu. Sie kommt direkt von Snapchat. Fotos und Videos werden verschickt, einmal angesehen und verschwinden dann wieder.

Was nach einem harmlosen Feature klingt, gehört zu den riskantesten Mechaniken, die wir im digitalen Raum kennen.

Bild generiert mit Hilfe von KI (ChatGPT/DALL·E, OpenAI)

Was genau wird getestet?

„Instants“ wird aktuell in ersten Versionen getestet, unter anderem in Italien und Spanien. Parallel existieren interne Prototypen bei Meta Platforms, die noch gar nicht öffentlich ausgerollt sind.

Die Funktionen:

Fotos und Videos können nur einmal angesehen werden

Inhalte löschen sich automatisch nach spätestens 24 Stunden

Versand nur an enge Kontakte (gegenseitige Follower, Close Friends)

Kaum Bearbeitungsmöglichkeiten

In Deutschland gibt es aktuell keinen offiziellen Rollout als eigene App. Einzelne Funktionen rund um verschwindende Inhalte existieren aber bereits innerhalb von Instagram (z. B. im Direktnachrichten-Bereich).

Das heißt: Die Mechanik ist längst da. Sie wird jetzt nur weiter ausgebaut.

Warum der Vergleich mit Snapchat so wichtig ist

Snapchat war die Plattform, die genau dieses Prinzip groß gemacht hat:

Inhalte verschwinden

Kommunikation passiert im Privaten

Kontrolle wird reduziert

Genau diese Struktur hat massive Probleme erzeugt. Und diese Probleme sind gut dokumentiert.

Wir haben schon oft darüber berichtet:

Snapchat schützt Täter durch Design: Warum Kinder unter 16 dort nichts verloren haben: https://www.medienzeit-elternblog.de/blog/snapchat-nichts-fuer-kinder-u-16

Studie: Snapchat zählt zu den wichtigsten Tatorten sexualisierter Gewalt: https://www.medienzeit-elternblog.de/blog/studie-kanada-snapchat-tatort-sexualisierte-gewalt

Snapmaps - Risiken für Kinder und wie Eltern sie schützen können: https://www.medienzeit-elternblog.de/blog/snapmaps-risiken-fuer-kinder-erkennen

Die Risiken von Snapchat – und warum sie hier wieder relevant werden

Studien und auch die Praxis zeigen seit Jahren, was in solchen Umgebungen passiert:

Sexting unter Minderjährigen wird normalisiert

Nacktbilder werden verschickt, weitergeleitet oder als Druckmittel genutzt

Grooming findet gezielt über private Kontakte statt

Täter bauen Vertrauen auf und verschieben Gespräche schnell in geschlossene Räume

Cybermobbing wird schwerer nachweisbar, weil Inhalte verschwinden

Strafverfolgungsbehörden und Kinderschutzorganisationen weisen immer wieder darauf hin, dass genau diese Funktionen Täter begünstigen. Verschwindende Inhalte bedeuten nicht weniger Risiko. Sie bedeuten weniger Beweise.

Ein Raum, der für Täter ideal ist

Bild generiert mit Hilfe von KI (ChatGPT/DALL·E, OpenAI)

Man muss es klar benennen. Private, nicht einsehbare Kommunikationsräume gehören zu den größten Risikofaktoren für Kinder im Netz. Dort passieren die schwerwiegendsten Vorfälle und nicht im öffentlichen Feed und auch nicht im sichtbaren Kommentarbereich.

Sondern genau hier:

in Direktnachrichten

in kleinen Gruppen

in temporären, verschwindenden Formaten

Diese Räume sind für Eltern kaum zugänglich. Für Schulen praktisch unsichtbar. Und für Plattformen schwer zu kontrollieren.

Wenn eine neue App genau darauf optimiert wird, verschiebt sich das Risiko nicht. Es wächst.

Was in solchen Räumen passiert

Im Grunde begünstigen die Features leider immer wieder pädokriminelle Netzwerke. Der Begriff ist hart, aber er beschreibt ein reales Problem. Die Risiken sind keine Theorie. Sie sind seit Jahren dokumentiert und werden in der Praxis immer wieder sichtbar.

Digitale Räume, in denen Inhalte verschwinden, Kontakte privat bleiben und Kommunikation kaum nachvollziehbar ist, werden gezielt ausgenutzt.

Das betrifft:

Grooming

Erpressung

sexuelle Ausbeutung

Aufbau von Abhängigkeiten

Wenn ein Konzern wie Meta diese Mechaniken weiter ausbaut, stellt sich zwangsläufig die Frage: Warum wird ein System verstärkt, das genau solche Dynamiken begünstigt?

Warum Meta diesen Weg trotzdem geht

Die Antwort ist einfach: Nutzung. Social Media hat sich verändert. Weniger öffentliche Posts und mehr private Kommunikation.

Für Plattformen bedeutet das:

längere Nutzungszeiten

stärkere Bindung

intensivere Interaktion

Das Problem dabei ist nicht die Technik an sich. Das Problem ist, dass Schutzmechanismen nicht Schritt halten.

Was Eltern jetzt wissen sollten

Die wichtigste Erkenntnis: Gefahr entsteht nicht durch einzelne Apps, sie entsteht durch bestimmte Mechaniken.

Und „Instants“ bündelt gleich mehrere davon:

Verschwindende Inhalte

private Kommunikation

reduzierte Nachvollziehbarkeit

schnelle, impulsive Interaktion

Das ist eine Kombination, die für Kinder hochriskant ist.

Fazit

Ob „Instants“ nach Deutschland kommt, ist aktuell offen. Dass sich diese Form der Kommunikation weiter verbreitet, ist dagegen sehr wahrscheinlich. Und damit auch die Risiken, die wir von Snapchat längst kennen.

Deshalb braucht es eine klare Haltung.

Kinder bewegen sich nicht einfach in digitalen Räumen. Sie bewegen sich in Systemen, die Verhalten gezielt steuern. Und genau deshalb reicht es nicht, nur zu begleiten. Es braucht Schutz und auch klare Grenzen.

Quellen

Business Insider: https://www.businessinsider.com/instagram-meta-working-on-internal-prototype-disappearing-messages-snapchat-2026-2

Yahoo: https://tech.yahoo.com/social-media/articles/instagram-rolling-app-thats-mix-183205536.html

TechCrunch: https://techcrunch.com/2026/04/23/instagram-tests-a-new-instants-app-for-sharing-disappearing-photos/