Vom Foto zum Datensatz: KI-Deepfakes verändern die Kindheit

LinkedIn-Post von Chan-jo Jun

Als Eltern teilen wir Fotos unserer Kinder meist aus Liebe. Wir wollen Erinnerungen bewahren, Nähe zeigen und besondere Momente festhalten. Lange fühlte sich das selbstverständlich und harmlos an. Doch diese Sicherheit gibt es nicht mehr. Im Zeitalter Künstlicher Intelligenz hat sich die Bedeutung eines Fotos grundlegend verändert. Ein Bild ist heute kein eingefrorener Moment mehr, sondern ein Datensatz mit einer ungewissen Zukunft.

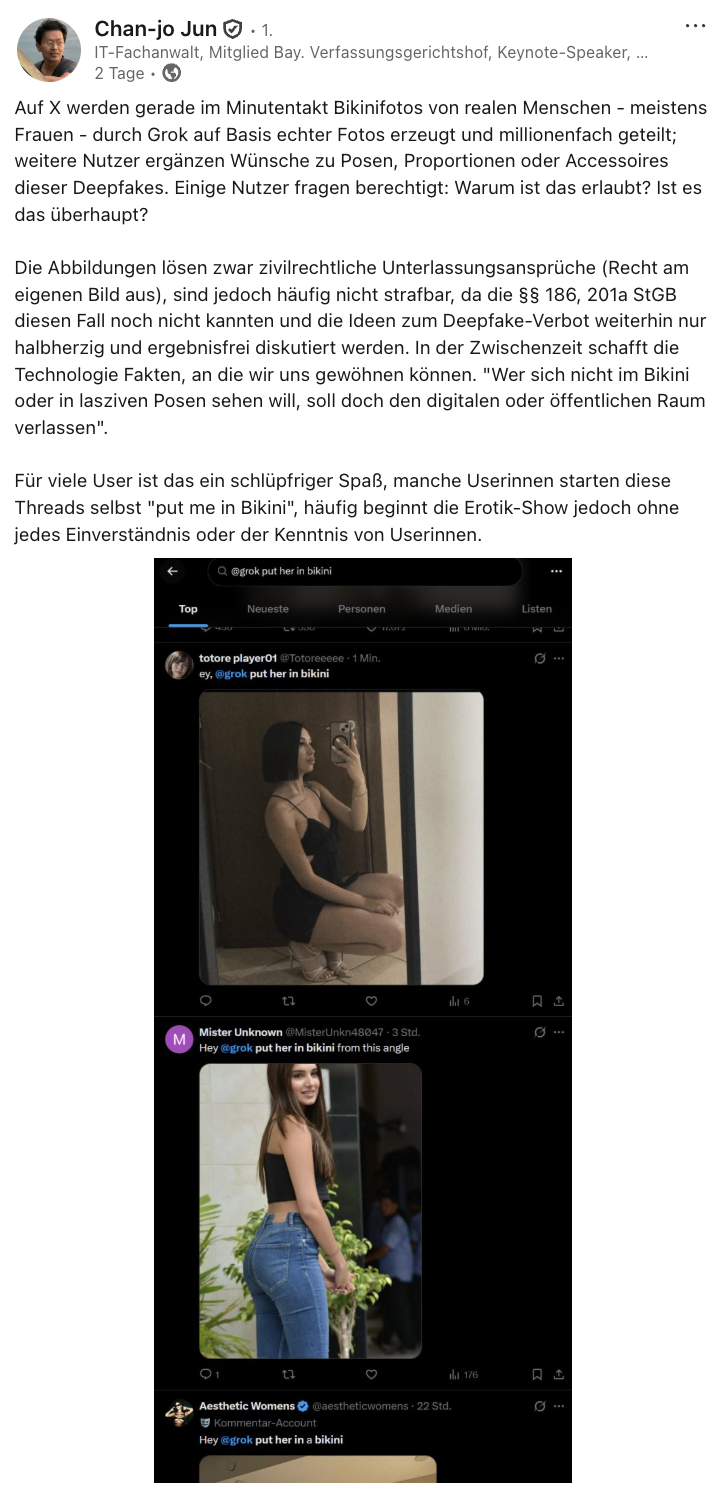

Was derzeit auf Plattformen wie X sichtbar wird, ist kein Ausreißer, sondern ein realistischer Blick auf das, was technisch längst möglich ist. KI-Systeme erzeugen aus echten Fotos täuschend echte Bilder realer Menschen. Andere Nutzer verändern diese Bilder weiter, sexualisieren sie, setzen sie in neue Kontexte und verbreiten sie öffentlich. Oft geschieht das ohne Einverständnis und ohne Wissen der Betroffenen.

Der IT-Fachanwalt Chan-jo Jun beschreibt diese Entwicklung als besonders problematisch, weil die Technik schneller voranschreitet als Recht und Schutzmechanismen. Für Erwachsene ist das verstörend. Für Kinder und Jugendliche kann es lebensprägend sein.

Ein einziges Foto kann reichen

Moderne KI benötigt keine umfangreichen Bildergalerien mehr. Ein einzelnes gut erkennbares Gesicht genügt oft, um daraus neue Bilder zu erzeugen. Andere Körper, andere Situationen, andere Bedeutungen.

Ein Foto aus einem Familienchat, von einer Schulwebseite oder aus einer vermeintlich privaten Gruppe kann morgen Teil eines Deepfakes sein. Diese Bilder lassen sich nicht einfach löschen. Sie können gespeichert, kopiert und immer wieder neu erzeugt werden. Was einmal digital existiert, bleibt potenziell verfügbar.

Kinder haben darauf keinen Einfluss. Genau das macht sie so verletzlich.

Warum Kinder diese Entwicklung besonders trifft

Kinder wachsen heute mit permanenter Sichtbarkeit auf. Bilder von Geburtstagen, Videos aus dem Urlaub, Fotos aus Vereinen oder Schulprojekten gehören für viele Familien zum Alltag. Meist steckt keine böse Absicht dahinter. Aber Kinder können nicht überblicken, welche Spuren dadurch entstehen.

Sie wissen nicht, wer ihre Bilder speichert. Sie können nicht einschätzen, wofür diese Bilder in Zukunft genutzt werden. Und sie haben kaum Möglichkeiten, sich zu wehren, wenn Inhalte missbraucht werden.

Besonders belastend ist, dass der Schaden nicht erst dann entsteht, wenn etwas öffentlich viral geht. Schon die Möglichkeit reicht. Das Wissen, dass Bilder von einem selbst manipuliert existieren könnten. Diese Unsicherheit kann das Selbstbild, das Vertrauen in andere und das Gefühl von Sicherheit nachhaltig erschüttern.

Rechtlicher Schutz greift oft zu spät

Rechtlich ist die Situation ernüchternd. Deepfake-Bilder verletzen in der Regel das allgemeine Persönlichkeitsrecht und das Recht am eigenen Bild. Betroffene können Unterlassung und Löschung verlangen und in manchen Fällen Schadensersatz. In der Realität bedeutet das jedoch häufig lange Verfahren, hohe Hürden und enorme emotionale Belastung.

Strafrechtlich klafft eine gefährliche Lücke. § 201a StGB schützt vor der Verletzung des höchstpersönlichen Lebensbereichs durch echte Bildaufnahmen. KI-erzeugte Bilder fallen oft nicht darunter, weil sie keine realen Aufnahmen sind. § 186 StGB greift nur bei ehrverletzenden Tatsachenbehauptungen. Deepfakes sind jedoch visuelle Konstruktionen, die mit realen Gesichtern arbeiten, ohne klassische Tatsachen zu behaupten.

So entsteht ein Graubereich, in dem Inhalte klar übergriffig sind, aber häufig nicht eindeutig strafbar. Während über neue Gesetze diskutiert wird, normalisiert sich die Technik bereits im Alltag.

Bild generiert mit Hilfe von KI (Gemini, Google)

Der Widerspruch gegen KI-Training hilft, aber schützt nicht

Viele Eltern haben vom Widerspruch gegen das KI-Training bei Plattformen wie Facebook oder Instagram gehört. Dieser Schritt ist wichtig, vermittelt aber leicht ein falsches Sicherheitsgefühl.

Der Widerspruch gilt meist nur für zukünftige Inhalte. Bereits veröffentlichte Fotos wurden oft schon verarbeitet. Er schützt nicht davor, dass andere Nutzer Bilder speichern oder weiterverwenden. Und er greift nur bei einem einzelnen Anbieter, während unzählige andere KI-Modelle weiterhin öffentlich zugängliche Daten nutzen.

Trotzdem ist der Widerspruch sinnvoll. Jede Form von Datenminimierung zählt. Er ersetzt jedoch nicht die grundsätzliche Frage, wie viele Bilder wir überhaupt teilen möchten.

Identitätsdiebstahl beginnt oft unscheinbar

Ein besonders unterschätztes Risiko ist der gezielte Missbrauch von Kinderbildern. Ein einzelnes Foto, kombiniert mit einem Namen oder Hinweisen auf Schule oder Wohnort, kann ausreichen, um Fake-Profile zu erstellen.

Diese Profile werden genutzt, um Vertrauen aufzubauen, andere Kinder zu kontaktieren oder kriminelle Handlungen vorzubereiten. Auch digitale Erpressung nimmt zu. Normale Fotos werden mithilfe von KI in intime Deepfakes verwandelt, mit denen Kinder und Jugendliche unter Druck gesetzt werden.

Das sind keine Einzelfälle. Das passiert bereits heute.

Sharenting und die fremdbestimmte Identität

Sharenting beschreibt das Phänomen, dass Eltern das Leben ihrer Kinder umfassend online dokumentieren. Oft geschieht das aus Stolz oder Gewohnheit, manchmal auch aus dem Gefühl heraus, dazugehören zu müssen.

Die Folgen sind gravierend. Viele Kinder haben bereits eine umfangreiche digitale Identität, bevor sie selbst entscheiden können, ob sie überhaupt sichtbar sein wollen. Wir nehmen ihnen damit die Möglichkeit, später selbst zu bestimmen, wie sie im Netz wahrgenommen werden.

Was Eltern als liebevolle Erinnerung empfinden, kann für Kinder später beschämend oder belastend sein. Private Momente können zu Mobbing führen. Kinder werden zu Inhalten, obwohl sie Schutz brauchen.

Bild generiert mit Hilfe von KI (Gemini, Google)

Warum WhatsApp / Messenger keine sicheren Räume sind

Auch Messenger vermitteln häufig ein trügerisches Gefühl von Sicherheit. Zwar sind Chats verschlüsselt, doch sobald ein Bild geteilt wurde, lässt sich seine Weiterverwendung nicht mehr kontrollieren. Screenshots, Weiterleitungen und Speicherungen sind jederzeit möglich.

Verschlüsselung schützt den Übertragungsweg, nicht die Nutzung durch Empfänger.

Was wir als Eltern jetzt tun können

Die konsequenteste Regel ist unbequem, aber wirksam. Keine erkennbaren Kinderfotos online zu teilen, ist der sicherste Schutz.

Das bedeutet nicht, Kinder unsichtbar zu machen. Es bedeutet, bewusster zu handeln. Weniger zu posten. Später zu posten. Gesichter nicht klar erkennbar zu zeigen. Vor allem aber bedeutet es, das Nein eines Kindes ernst zu nehmen, auch wenn Erwachsene es harmlos finden.

Auch Schulen und Vereine sollten kritisch hinterfragt werden. Gemeinschaft funktioniert auch ohne öffentlich abrufbare Kinderfotos.

Fazit

Wir können die technische Entwicklung nicht aufhalten. Aber wir können entscheiden, wie viel wir von unseren Kindern preisgeben.

Im KI-Zeitalter ist Zurückhaltung kein Verlust. Sie ist Schutz. Und vielleicht einer der wichtigsten Wege, unseren Kindern heute Sicherheit, Würde und Selbstbestimmung zu bewahren.

Quellen und weiterführende Artikel bei Medienzeit

LinkedinPost von Chan-Jo Jun: https://www.linkedin.com/feed/update/urn:li:activity:7412537647178485761/

Widerspruch gegen Meta-KI: Schritt für Schritt erklärt: https://www.medienzeit-elternblog.de/blog/metas-ki-schuetzt-daten-eurer-kinder

Sharenting: Wenn Eltern zu viel teilen: https://www.medienzeit-elternblog.de/blog/sharenting-wenn-eltern-zu-viel-teilen

Warum Kinder kein Content sind: https://www.medienzeit-elternblog.de/blog/kinder-sind-kein-content

Digitale Erpressung und Sextortion: Eine wachsende Gefahr für Kinder und Jugendliche: https://www.medienzeit-elternblog.de/blog/sextortion-und-digitale-erpressung

Kinderfotos in Schulen und Vereinen: Warum Zurückhaltung schützt: https://www.medienzeit-elternblog.de/blog/schulen-und-vereine-kinderfotos